[논문 리뷰] Visible and Thermal Camera-based Jaywalking Estimation using a Hierarchical Deep Learning Framework

Abstract

기존 연구 문제 : 가시 카메라 기반 추정

→ 해결 : 가시 + 열화상 카메라 사용하는 2단계 계층적 딥러닝

2단계?

1) 장면 분류기

2) 장면별 의미론적 분할 프레임 워크

1. Introduction

무단 횡단 관련 사고 위험 → 자율 주행에서 무단 횡단 보행자 견고하게 추정해야

기존 가시 카메라를 이용한 무단 횡단 추정의 문제점

1. 조명 변화

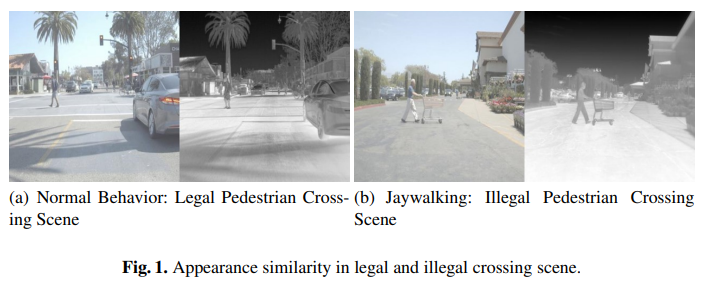

2. 정상적인 보행자 행동과 비정상적인 보행자 행동 간의 외관 유사성(Fig 1)

→ 정상 횡단 보행자와 무단 횡단 보행자가 구분되지 않음

3. 합법적인 보행자 횡단 지점 or 장면의 외관 변화(Fig 2)

→ Fig 2의 사진은 모두 정상 횡단 보행자 사진(Fig 3 참고).

하지만 도로에 있는 신호(?) 표시(?)가 달라 합법적인 보행자라 판단하기 힘듦

→ 횡단보도에서 건너지 않지만 합법적으로 건너는 경우를 말하는 것 같다!

4. 환경 잡음

해결 : '가시 및 열화상 카메라'를 사용하는 '2단계 계층적 프레임워크'

- '가시 및 열화상 카메라' → 1, 4번 문제 해결

- '2단계 계층적 프레임워크' → 2, 3번 문제 해결

[2단계 계층적 프레임워크]

1) 분류 단계

- 딥러닝 기반 단일 장면 분류기

- 합법적인 보행자 횡단 장면 / 불법적인 무단 횡단 장면으로 분류

2) 의미론적 분할 단계

- 1st : 합법적인 보행자 횡단 장면에서 학습

- 2nd : 불법적인 무단 횡단 장면에서 학습

→ 합법적인 보행자와 불법적인 무단 횡단 보행자를 개별적으로 학습함.

→ 이미지에서 정상 보행자와 무단 횡단 보행자를 추정

기존 알고리즘과 비교했을 때 우수한 성능, 실시간 계산 복잡도

2. Related Work

1. 보행자 감지

- hand-crafted features 기반

- 딥러닝 기반

2. 보행자 행동 추정(보행자 감지에서 얻어진 보행자의 공간적, 맥락적, 시간적 정보 → 보행자 행동 추정에 이용)

- 확률적 모델링 기반

- 공간적 맥락 신호를 통한 전통적인 프레임워크 기반

(bag-of-words 프레임워크 내 보행자 공간-시간 정보 모델링 → 베이지안 프레임워크 내 보행자 글로벌 + 로컬 특징 추출)

- 딥러닝 모델 기반 (LSTM 이용 → ResNet + LSTM 이용)

3. Algorithm

3.1 Classification Step

레이어 구성 : 특징 추출 + 분류 + 출력

- 특징 추출

- 가시 카메라 + 열화상 카메라 특징 추출 위해 2개의 분기(5개의 블록)

- 1~4 : 2D 컨볼루션 레이어 + max-pooling 레이어

- 5 : 확장된 2D 컨볼루션 레이어

- 융합을 위한 하나의 분기(5개의 블록)

- 1~3 : 2D 컨볼루션 레이어 + max-pooling 레이어

- 4 : 확장된 2D 컨볼루션 레이어

- 5 : 1x1 컨볼루션 레이어(특징 맵 축소)

- 분류 : 2개의 Fully connected layer + ReLu

- 출력 : sigmoid 이용해 이진 분류 → 합법적인 보행자 횡단 장면 / 불법적인 무단 횡단 장면

3.2 Semantic Segmentation Step

1. 합법적인 보행자 횡단 장면에서 학습

2. 불법적인 무단 횡단 장면에서 학습

→ 정상 보행자, 무단 횡단 보행자, 배경으로 분류

- encoder 레이어 = 분류 단계 특징 추출 레이어

- decoder 레이어

- 5개의 합성곱 레이어

- 4개의 전치 합성곱 레이어(인코더 특징 맵 업샘플링)

- 출력 레이어 : softmax 이용 다중 클래스 의미론적 분할 수행

3.3 Hierarchical Framework : Training

데이터셋 : FLIR(열화상 카메라로 촬영된 데이터 얻을 수 있음)

데이터셋에서 수동으로 선택된 프레임은 수동으로 합법적인 보행자 횡단 장면과 불법적인 무단 횡단 장면으로 분할

- 분류 : 모든 프레임(합법 + 불법) 이용

- 의미론적 분할 네트워크

- 1st : 합법적인 보행자 횡단 장면만

- 2nd : 불법적인 무단 횡단 장면만

3.4 Hierarchical Framework : Testing

- 분류

- 입력 : 열화상 + 가시 카메라 이미지

- 출력 : 이미지 합법 or 불법 분류 + 장면 레이블 c 할당

- 의미론적 분할 네트워크

- 추정된 c번째 장면 레이블 사용하여 학습된 → c번째 장면 기반 이미론적 네트워크(합법 or 불법) 검색

- 입력 : 열화상 + 가시 카메라 이미지

- 출력 : 무단 횡단 보행자

4. Experimental Results

데이터셋 : FLIR에서 수동으로 선택된 하위 집합 사용(2799 학습 + 313 테스트)

- 성능 측정

- 픽셀 분할 정확도

- IoU

- 분류 정확도

baseline

- 계층적 프레임워크(MFNet, Fusenet)

- 단일 encoder 사용하는 계층적 방법

- 가시 카메라 or 열화상 카메라 입력을 유일한 입력으로 받는 계층적 방법

- end-to-end 의미론적 분할

4.1 Comparative Analysis

제안된 딥러닝 아키텍처 > MFNet or Fusenet

가시 + 열화상 카메라 모두 입력으로 > 가시 or 열화상 카메라만 입력으로

제안된 계층적 접근법 > end-to-end 의미론적 분할 or 단일 인코더 사용

5. Summary

무단 횡단 추정을 위한 계층적 딥러닝 프레임워크를 가시 및 열화상 카메라를 사용하여 제안.

2단계로 구성된 계층적 프레임워크는 분류와 의미론적 분할 단계를 포함

FLIR 공개 데이터셋에서 검증, 기존 알고리즘보다 더 높은 정확도

내용을 간단히 요약하자면,

가시 및 열화상 카메라 데이터를 통해 조명 변화, 잡음에 강건하게,

계층적 프레임 워크를 통해 정상/비정상 보행자 행동 유사성, 합법적인 보행자 장면 변화 해결.

논문에서 얻을 수 있었던 점

- 저번 논문(LSFM) 논문에서 비가 오거나 날씨가 흐린 경우와 낮이 아닌 밤일 때 보행자 탐지에 대한 발전 방향을 제시하였다.

(LSFM에서는 날씨가 흐린 경우와 밤의 데이터를 제외하고 학습시켰다.)

가시 카메라가 아닌 열화상 카메라를 모두 이용하면 이 부분에 대해서 어느 정도 해결이 될 수 있을 것 같다!

- 열화상 데이터에 대한 인식

무단 횡단 탐지를 위한 프로젝트를 진행하고 있는데, 무단 횡단 데이터를 구하는 데에 가장 어려움을 겪고 있다.

(현재는 다행히 결정되었다!)

열화상 데이터도 이용할 수 있다는 인사이트를 얻을 수 있었으나,

해당 논문에서도 무단횡단 여부를 모두 수동으로 라벨링했다고 해서 아쉬웠다.

(무단횡단 라벨링이 되어 있는 데이터는 역시 없구나....

혹시나 관련 데이터를 알고 계시다면 언제든지 댓글 부탁려요....

처참한 나의 구글링 실력.....)

- 무단 횡단 상황에서 문제 상황 인식

프로젝트 진행 중에 가장 걱정이 되었던 것은

무단 횡단을 '탐지'하는 것은 좋은 모델을 이용하면 충분히 해결될 수 있겠지만,

어떻게 탐지해야 하는지 모른다는 것.

팀원들이 무단 횡단 상황에 대하여 도메인 지식(?)이 부족한 상태였다.

따라서 해당 논문을 읽으며 무단횡단 탐지를 위한 방법론을 익히는 것이 목표였는데,

무단 횡단에서 발생하는 문제 상황을 인지하고 해결 방법을 알게 된 것에 의미가 있는 것 같다!

참고 문헌